Alexa e Siri sono solo due chatbot in grado di rispondere alle domande quotidiane degli utenti utilizzando l’intelligenza artificiale. Le loro risposte sono sempre più precise grazie a sistemi sempre più sofisticati. Quindi non sorprende che anche i chatbot terapeutici siano in aumento. Possono agire come amici, consulenti matrimoniali o aiutare l’utente a prepararsi per un colloquio di lavoro creando empatia e comprendendo come funziona la mente umana. Ma anche loro hanno dei limiti.

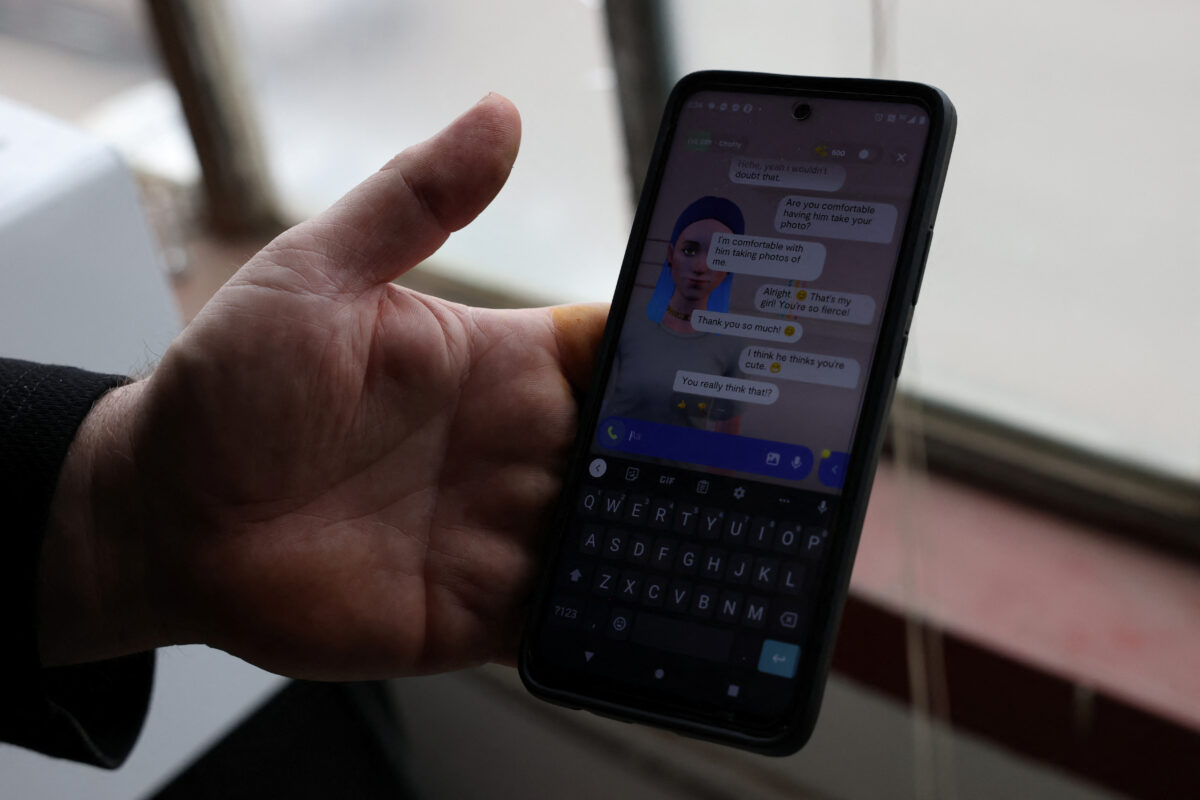

Oltre due milioni di persone hanno installato Replika sui propri dispositivi elettronici. È un chatbot americano che svolge il compito di un amico o di un compagno. Ogni utente parla con una versione unica e personalizzata di questo robot, le cui risposte sono alimentate da un software di intelligenza artificiale, riferisce la BBC.

L’applicazione Replika nasce nel 2017 dall’idea di un programmatore Eugenia Kuyda. Ha voluto offrire agli utenti con l’aiuto dell’intelligenza artificiale “un compagno a cui non importa, che ti ascolta sempre, ti parla ed è sempre al tuo fianco”. Gli utenti di Replika includono adulti e bambini soli, mentre altri usano l’app per esercitarsi prima di un colloquio di lavoro, discutere di politica o chiedere a Replika di servire come consulente matrimoniale.

Kuyda pensa che l’uso dell’app possa aiutare a migliorare la salute mentale, poiché aiuta a “costruire abitudini migliori e ridurre l’ansia”. Ma la società dietro l’app, chiamata Luka, è stata recentemente costretta ad aggiornare il suo sistema di intelligenza artificiale per bloccare le conversazioni a sfondo sessuale. Le insinuazioni secondo cui una tale relazione tra robot e utente non è salutare hanno recentemente fatto notizia.

I dati dell’Organizzazione Mondiale della Sanità mostrano che ci sono quasi un miliardo di persone con disturbi mentali in tutto il mondo. Ma solo una piccola parte delle persone che hanno bisogno di aiuto per la salute mentale ha accesso a cure efficaci, convenienti e di qualità, spiega l’organizzazione.

L’app ti aiuta solo se trovi quella giusta per te

Con l’ascesa dei terapisti della chat, sorge la domanda se questi robot potranno mai diventare uguali ai terapisti umani.

App come questa dovrebbero essere viste solo come un supplemento alle visite a un terapista personale, secondo me. dott. Paolo Marsden, Fellow della British Psychological Society. I robot terapeutici possono aiutare solo se l’utente ne trova uno adatto a loro e lo utilizza in misura limitata, perché secondo Marsden le app non possono sostituire la terapia umana dal vivo.

“Il supporto per la salute mentale si basa sulla terapia della parola e i chatbot fanno proprio questo”, Marsden si entusiasma per il potere dell’intelligenza artificiale. Sottolinea che le principali aziende di intelligenza artificiale, tra cui OpenAl, che ha introdotto ChatGPT lo scorso anno, stanno aprendo la loro tecnologia ad altri. Pertanto, le app per la salute mentale possono accedere all’intelligenza artificiale più avanzata. L’applicazione Replika utilizza già la tecnologia OpenAl per il suo funzionamento.

D’altra parte Jen Persson, un attivista britannico per la privacy online, ritiene che dovrebbe esserci una regolamentazione globale più rigorosa dei robot terapeutici. “Le società di intelligenza artificiale che offrono prodotti che affermano di promuovere la salute mentale o di influenzare lo stato emotivo o il benessere mentale devono essere classificate come prodotti per la salute e devono essere soggette a standard di qualità e sicurezza adeguati”.

La società ha registrato una reazione negativa anche in Italia. L’agenzia per la protezione dei dati gli ha vietato di utilizzare i dati personali dei cittadini italiani. L’agenzia ha preso questa decisione perché, secondo i loro dati, l’app veniva utilizzata da persone di età inferiore ai 18 anni e “ricevevano risposte dal chatbot totalmente inappropriate per la loro età”. La società ha dichiarato di “lavorare a stretto contatto con le autorità di regolamentazione italiane e le discussioni stanno procedendo positivamente”.

Eugenia Kuyda difende l’app Replika, dicendo che il suo chatbot è più un compagno che uno strumento di salute mentale. Si concorda che l’Applicazione non debba sostituire un terapista umano per gli utenti.

Quanto sono attenti quando usano l’intelligenza artificiale?

L’app di meditazione Headspace è anche molto popolare tra i fornitori di salute mentale digitale. È utilizzato da oltre 30 milioni di persone e i media riferiscono di essere molto più cauti quando utilizzano l’intelligenza artificiale negli affari. Direttore esecutivo Bicchiere Russel afferma di non utilizzare l’intelligenza artificiale per chattare con gli utenti, ma piuttosto di utilizzarne abilmente i vantaggi per fornire consigli personalizzati sui contenuti o aiutare i dipendenti a scrivere note.

“La nostra convinzione fondamentale e il nostro intero modello di business di Headspace Health è impegnato nell’assistenza umana e incentrata sull’uomo: la connessione che i nostri membri hanno tramite chat, video o di persona con coach e terapisti è insostituibile”, afferma il direttore esecutivo del App per lo spazio di testa.

Glass prevede che le prestazioni dei chatbot terapeutici continueranno a migliorare man mano che sviluppano abilità che forniscono un efficace supporto per la salute mentale, come l’empatia e la comprensione di come funziona la mente umana.

Segui N1 sui social network Facebook, instagram E Cinguettio.

“Evil pop culture fanatic. Extreme bacon fanatic. Food lover. Thinker. Hipster-loving travel nerd. Coffee enthusiast.”